Глубокое обучение является одним из наиболее инновационных и эффективных подходов к обработке данных и решению сложных задач в области искусственного интеллекта и машинного обучения. Оно основано на использовании нейронных сетей, которые имитируют работу человеческого мозга и обладают способностью самостоятельно учиться и адаптироваться к условиям окружающей среды.

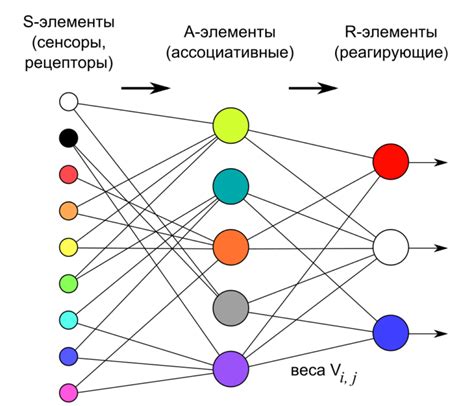

Принципы глубокого обучения: Глубокое обучение в нейронных сетях основывается на использовании глубоких архитектур, состоящих из множества слоев нейронов. Каждый слой обрабатывает информацию, получаемую от предыдущего слоя, и передает ее на следующий слой сети. Такое построение нейронных сетей позволяет добиться более высокого уровня абстракции и позволяет решать более сложные задачи, чем традиционные нейронные сети.

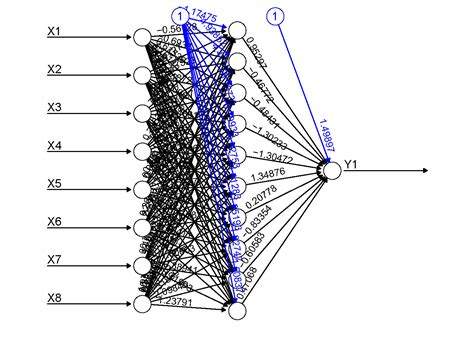

Ключевой принцип глубокого обучения – использование алгоритмов обратного распространения ошибки. В процессе обучения сети алгоритм проверяет результаты и корректирует веса связей между нейронами, чтобы минимизировать ошибку. Этот процесс повторяется на каждом слое сети, что позволяет ей постепенно улучшать свои результаты и достигать впечатляющих успехов в различных областях.

Применение глубокого обучения в нейронных сетях находит широкое применение во многих отраслях, таких как компьютерное зрение, естественная обработка языка, автономные транспортные средства, медицинская диагностика и многое другое. Благодаря своей способности выделять сложные закономерности в больших объемах данных, глубокое обучение становится все более востребованным инструментом для решения сложных задач и создания инновационных технологий.

В чем заключаются принципы глубокого обучения в нейронных сетях?

В глубоком обучении нейронных сетей используются различные принципы:

Иерархическая структура: нейронные сети в глубоком обучении имеют несколько слоев, которые последовательно анализируют информацию на разных уровнях абстракции. Это позволяет сетям выделять более высокоуровневые признаки и осуществлять более сложные вычисления.

Обратное распространение ошибки: при обучении глубоких нейронных сетей используется алгоритм обратного распространения ошибки. Он позволяет сети корректировать веса нейронов, итеративно минимизируя ошибку между предсказанными и фактическими значениями.

Использование активационных функций: активационная функция применяется к выходу каждого нейрона в нейронной сети. Она добавляет нелинейность в пространство базовых функций, что позволяет сети моделировать более сложные зависимости и более точно аппроксимировать данные.

Свертка и пулинг: сверточные нейронные сети являются одним из наиболее распространенных видов глубоких нейронных сетей. Они используют сверточные слои для выделения локальных особенностей изображений и пулинговые слои для снижения размерности и объема данных.

Регуляризация: глубокие нейронные сети часто страдают от переобучения, что означает, что они слишком точно настраиваются на тренировочные данные и плохо обобщаются на новые данные. Для борьбы с этим применяются различные методы регуляризации, такие как исключение случайных нейронов во время обучения или добавление шума.

Все эти принципы вместе обеспечивают гибкую и мощную систему обработки информации, которая может быть применена во многих областях, таких как компьютерное зрение, естественный язык, распознавание речи и другие.

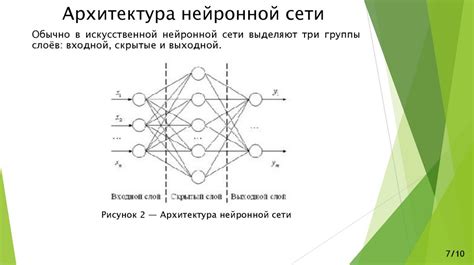

Архитектура и структура глубоких нейронных сетей

Структура глубоких нейронных сетей обычно организована слоями, которые последовательно передают информацию друг другу. Первый слой называется входным, а последний - выходным. Между ними могут находиться несколько промежуточных слоев, называемых скрытыми слоями. Скрытые слои выполняют преобразование данных, извлекая из них важные признаки и формируя высокоуровневое представление.

Общая структура глубоких нейронных сетей может быть различной, в зависимости от конкретной задачи и используемой архитектуры. Сети могут состоять из одного или нескольких вида слоев, включая сверточные, рекуррентные и полносвязные.

Сверточные слои применяются в задачах компьютерного зрения и обработки изображений. Они выполняют операцию свертки, с помощью которой сеть находит локальные шаблоны и закономерности в данных.

Рекуррентные слои применяются в задачах обработки последовательностей данных, таких как тексты и речь. Они обеспечивают память и учитывают контекст, сохраняя информацию о предыдущих состояниях.

Полносвязные слои являются основной составляющей глубоких нейронных сетей. Они устанавливают связи между каждым нейроном предыдущего слоя и каждым нейроном следующего слоя, что позволяет моделировать сложные зависимости и реализовывать высокую степень non-linearity (нелинейности).

Таким образом, архитектура и структура глубоких нейронных сетей представляют собой сложную композицию различных слоев, выполняющих специфические функции обработки данных. Это позволяет нейронным сетям использовать гибкие и масштабируемые модели, способные эффективно решать широкий спектр задач в разных областях.

Роль функций активации в глубоком обучении

Одной из наиболее распространенных функций активации является сигмоидная функция (logistic function). Она принимает входные значения и возвращает значения между 0 и 1. Сигмоидная функция часто используется для задач классификации, где требуется определить принадлежность к одному из двух классов.

Другой распространенной функцией активации является функция ReLU (Rectified Linear Unit). Она определяет активацию нейрона как максимум из 0 и входного значения. Функция ReLU очень популярна в глубоком обучении из-за своей простоты и эффективности. Она помогает сети избегать проблемы затухающего градиента и способна обрабатывать большие объемы данных.

Еще одной из функций активации, используемой в глубоком обучении, является функция softmax. Эта функция используется в многоклассовой классификации, где требуется присвоить объекту один из нескольких классов. Функция softmax принимает входные значения и преобразует их в вероятности для каждого класса.

Выбор правильной функции активации имеет решающее значение для работы нейронной сети. Разные функции активации подходят для различных типов задач. Правильный выбор функции активации позволит сети лучше аппроксимировать данные и осуществлять нужное преобразование на каждом слое. Однако, выбор функций активации и их параметров является задачей, требующей экспериментов и настройки.

| Функция активации | Описание | Применение |

|---|---|---|

| Сигмоидная функция | Преобразует входные значения в интервал от 0 до 1 | Классификация |

| ReLU | Активирует нейрон, если входное значение положительное | Распознавание образов, обработка больших объемов данных |

| Softmax | Преобразует входные значения в вероятности для каждого класса | Многоклассовая классификация |

В целом, функции активации играют важную роль в глубоком обучении, определяя способность нейронной сети моделировать сложные нелинейные зависимости. Выбор правильной функции активации может помочь улучшить результаты нейронной сети и достичь лучшей производительности в задачах обработки данных.

Основные типы алгоритмов обучения в нейронных сетях

- Алгоритм обратного распространения ошибки (Backpropagation)

- Градиентный спуск (Gradient Descent)

- Алгоритм стохастического градиентного спуска (Stochastic Gradient Descent)

- Алгоритм Adam

Этот алгоритм является одним из самых популярных и широко используется для обучения нейронных сетей. Основная идея заключается в прямом распространении входных данных через сеть и вычислении ошибки на выходе. Затем ошибка обратно распространяется по сети с целью корректировки весов в каждом слое. Процесс повторяется до достижения минимальной ошибки.

Этот метод оптимизации широко используется в области машинного обучения и глубокого обучения. Градиентный спуск основан на вычислении градиента функции стоимости и изменении весов в направлении, противоположном градиенту. Цель состоит в минимизации функции стоимости и достижении оптимальных значений весов.

Этот алгоритм является вариантом градиентного спуска, который обрабатывает случайные подмножества данных (батчи) для обучения нейронной сети. Вместо вычисления градиента функции стоимости для всех данных, случайно выбираются небольшие батчи для обновления весов. Это позволяет ускорить процесс обучения, особенно на больших наборах данных.

Adam (Adaptive Moment Estimation) - это один из самых эффективных алгоритмов оптимизации для обучения нейронных сетей. Он комбинирует идеи градиентного спуска и адаптивного оценивания момента второго порядка. Adam автоматически адаптирует скорость обучения для каждого параметра в сети и обеспечивает быструю сходимость к оптимальным значениям весов.

Это лишь несколько примеров основных типов алгоритмов обучения в нейронных сетях. Каждый из них имеет свои преимущества и недостатки, и выбор конкретного алгоритма зависит от задачи и требуемой точности обучения.

Применение глубокого обучения в различных сферах

Медицина и биология

В медицине глубокое обучение применяется для диагностики заболеваний, прогнозирования их развития, а также для разработки новых лекарственных препаратов. С помощью нейронных сетей и анализа медицинских данных происходит раннее выявление рака, болезни сердца и других патологических состояний, что позволяет улучшить эффективность лечения и спасти множество жизней. Также глубокое обучение используется в биологии для анализа генетических данных, исследования протеинов и предсказания структуры молекул.

Транспорт и логистика

В сфере транспорта и логистики глубокое обучение помогает автоматизировать и оптимизировать процессы управления транспортными сетями. Нейронные сети способны анализировать данные о дорожной обстановке, прогнозировать загруженность маршрутов и оптимизировать время доставки. Это позволяет улучшить качество услуг, снизить затраты и уменьшить количество аварийных ситуаций.

Финансы и инвестиции

Глубокое обучение нашло широкое применение в финансовой индустрии. Нейронные сети успешно используются для прогнозирования финансовых рынков, анализа трендов и мониторинга риска. Благодаря этому финансовые компании и инвесторы могут принимать более обоснованные решения, улучшая свою прибыльность и снижая риски.

Информационная безопасность

Глубокое обучение играет все более значимую роль в обеспечении информационной безопасности. Нейронные сети способны обнаруживать атаки и аномалии в компьютерных сетях, идентифицировать вредоносные программы и защищать цифровые системы от киберпреступников. Это позволяет повысить уровень защиты информации и предотвратить множество потенциальных угроз.

Приведенные примеры лишь незначительная часть областей, в которых глубокое обучение имеет огромный потенциал. Благодаря своим уникальным способностям, глубокие нейронные сети позволяют решать сложные задачи и преобразовывать различные сферы нашей жизни.

Вызовы и будущее глубокого обучения в нейронных сетях

Однако, несмотря на все свои преимущества, глубокое обучение также сталкивается с рядом вызовов, которые необходимо решить для дальнейшего прогресса в этой области.

Подготовка и разметка данных

Глубокое обучение требует большого количества размеченных данных для обучения модели. Очень часто подготовка и разметка данных являются трудоемким и дорогостоящим процессом, особенно в случаях, когда требуется специализированная экспертная оценка. Кроме того, свежие и качественные данные могут быть недоступными или труднодоступными для некоторых задач.

Архитектура и оптимизация моделей

Выбор правильной архитектуры и оптимизация моделей являются значительными задачами в удалении, в связи с чем компромисс между скоростью обучения и точностью модели может быть непростым. Разработка эффективных алгоритмов обучения и оптимизации является активной областью исследований.

Вычислительные ресурсы и инфраструктура

Глубокое обучение требует больших вычислительных ресурсов, включая высокопроизводительные графические процессоры (GPU) и кластеры серверов. Обеспечение нужной инфраструктуры может представлять сложности для исследователей и разработчиков, особенно для небольших организаций или начинающих специалистов.

Несмотря на вызовы, глубокое обучение в нейронных сетях имеет огромный потенциал и обещает радикально изменить множество областей. Будущее глубокого обучения может включать в себя разработку более эффективных алгоритмов, улучшение процесса разметки данных и доступ к более мощной вычислительной инфраструктуре.

Глубокое обучение в нейронных сетях продолжает привлекать внимание исследователей и разработчиков, и его развитие обещает привести к инновациям и решению сложных задач в различных областях.